Falacia de transposición de condicionales.

La falacia de transposición de condicionales surge por una mala comprensión del concepto del valor de p y de la probabilidad condicionada.

Una falacia es un argumento que parece válido pero no lo es. A veces se usan para engañar a la gente y darles gato por liebre, pero la mayor parte de las veces se utilizan por una razón mucho más triste: por pura ignorancia.

Hoy vamos a hablar de una de estas falacias, muy poco reconocida, pero en la que se cae con una gran frecuencia a la hora de interpretar resultados de contrastes de hipótesis.

Cada vez más vemos que las publicaciones científicas nos proporcionan el valor exacto de p, de forma que tendemos a pensar que cuánto menor es el valor de p mayor es la plausibilidad del efecto observado.

Para entender lo que vamos a explicar, recordemos primero la lógica de la falsificación de la hipótesis nula (H0). Partimos de una H0 de que el efecto no existe, por lo que calculamos la probabilidad de, por azar, encontrar unos resultados tan extremos o más que los que hemos encontrado, siendo H0 cierta.

Esta probabilidad es el valor de p, de forma que cuanto menor sea, menos probable es que el resultado sea debido al azar y, por tanto, más probable que el efecto sea real. El problema es que, por muy pequeña que sea la p, siempre hay una probabilidad de cometer un error de tipo I y rechazar la H0 siendo cierta (o lo que es lo mismo, obtener un falso positivo y dar por bueno un efecto que en realidad no existe).

Es importante tener en cuenta que el valor de p solo indica si hemos alcanzado el umbral de significación estadística, que es un valor totalmente arbitrario. Si obtenemos un valor umbral de p = 0,05 tendemos a pensar una de las cuatro posibilidades siguientes:

- Que hay un 5% de probabilidades de que el resultado sea un falso positivo (de que H0 sea cierta).

- Que hay un 95% de probabilidades de que el efecto sea real (de que H0 sea falsa).

- Que la probabilidad de que el efecto observado se deba al azar es del 5%.

- Que la tasa de error de tipo I es del 5%.

Sin embargo, todo lo anterior es incorrecto, ya que estamos cayendo en la falacia inversa o falacia de la transposición de condicionales. Todo es un problema de entender mal las probabilidades condicionadas. Vamos a verlo despacio.

La falacia de la transposición de condicionales (falacia inversa)

A nosotros nos interesa saber cuál es la probabilidad de que H0 sea cierta una vez que hemos obtenido unos resultados. Expresado matemáticamente, queremos saber P(H0|resultados). Sin embargo, el valor de p lo que nos proporciona es la probabilidad de obtener nuestros resultados si la hipótesis nula es cierta, o sea, P(resultados|H0).

Vamos a verlo con un ejemplo sencillo. La probabilidad de ser español si uno es andaluz es alta (debería ser del 100%). La inversa es más baja. La probabilidad de tener cefalea si uno tiene una meningitis es alta. La inversa es más baja. Si los eventos son frecuentes, la probabilidad será más alta que si son raros. Así, como nosotros queremos saber P(H0|resultados), deberemos valorar la probabilidad basal de la H0 para evitar sobrestimar las pruebas que apoyan que el efecto es cierto.

Si lo pensamos despacio, es bastante intuitivo. La probabilidad de H0 antes del estudio es una medida de la creencia subjetiva que refleja su plausibilidad basada en estudios previos. Pensemos que queremos contrastar un efecto que creemos muy poco probable que sea cierto. Valoraremos con precaución un valor de p < 0,05, aunque sea significativo. Por el contrario, si estamos convencidos de que el efecto existe, con poca p nos daremos por satisfechos.

En resumen, para calcular la probabilidad de que el efecto sea real deberemos calibrar el valor de p con el valor de la probabilidad basal de H0, que será asignada por el investigador o por datos previos disponibles. Ni que decir tiene que existe un método matemático para calcular la probabilidad posterior de H0 en función de su probabilidad basal y el valor de p, pero sería una grosería poner un formulón enorme a estas alturas de la entrada.

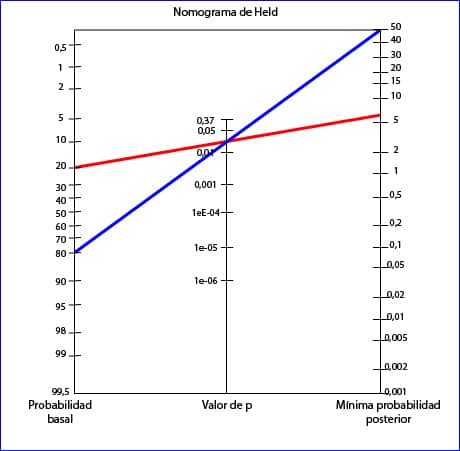

En su lugar, vamos a utilizar un método más sencillo, recurriendo a un recurso gráfico que se llama nomograma de Held y que podéis ver en la figura.

En su lugar, vamos a utilizar un método más sencillo, recurriendo a un recurso gráfico que se llama nomograma de Held y que podéis ver en la figura.

Para utilizar el nomograma de Held solo tenemos que trazar una línea desde la probabilidad previa que consideremos que tiene H0 hasta el valor de p y prolongarla para ver qué valor de probabilidad posterior alcanzamos.

Imaginad un estudio con un valor marginal de p = 0,03 en el que creemos que la probabilidad de la H0 es del 20% (creemos que hay un 80% de que el efecto sea real). Si prolongamos la línea nos dice que la probabilidad mínima de H0 del 6%: hay un 94% de probabilidad de que el efecto sea real.

Por otro lado, pensad en otro estudio con el mismo valor de p pero en el que pensamos que la probabilidad del efecto es más baja, por ejemplo, del 20% (la probabilidad de H0 es del 80%), Para un mismo valor de p, la probabilidad mínima posterior de H0 es del 50%, luego hay un 50% de que el efecto sea real. Vemos así como la probabilidad posterior cambia según la probabilidad previa.

Nos vamos…

Y aquí lo dejamos. Seguro que esto del nomograma de Held os ha recordado a otro nomograma mucho más famoso pero con una filosofía similar, el nomograma de Fagan. Este se utiliza para calcular la probabilidad postprueba en función de la probabilidad preprueba y el cociente de probabilidad de una prueba diagnóstica. Pero esa es otra historia…

Te cuento viejo que no entendí nada. Me quedaste debiendo lo de la falacia.